Modul 3 · KI verstehen

KI richtig nutzen

Von Einzelprompts zu persistenten Workflows. Wie man KI-Modelle versteht, sinnvoll einsetzt — und was dabei wirklich wichtig ist.

← → Navigieren · ESC zurück zur Übersicht

Einstieg

Warum „einfach fragen" nicht reicht

„Ich habe ChatGPT mal ausprobiert, aber die Antworten waren so generisch. Damit kann ich nichts anfangen."

Das ist kein Problem mit KI. Das ist ein Problem mit der Art, wie KI benutzt wird.

Was die meisten tun

Eine Frage eingeben. Antwort lesen. Enttäuscht sein. Aufhören.

Was funktioniert

Kontext geben. Ziel definieren. Iterieren. Workflows bauen, die morgen noch funktionieren.

Überblick

Was du in diesem Modul lernst

Ziel: Du verlässt dieses Modul mit konkreten Methoden — nicht Buzzwords.

Teil 1

Welches Modell — und warum?

Nicht jedes KI-Modell ist gleich. Die Unterschiede sind real — und relevant für das, was du damit tun willst.

Modelle

Claude, ChatGPT, Gemini — was ist der Unterschied?

| Eigenschaft | Claude (Anthropic) | ChatGPT (OpenAI) | Gemini (Google) |

|---|---|---|---|

| Trainingsphilosophie | Constitutional AI — Werte eingebettet | RLHF — Nutzerfeedback-optimiert | Multimodal-first, Google-Daten |

| Kontextfenster | 200.000 Token (ca. 150.000 Wörter) | 128.000 Token (GPT-4o) | 1 Mio. Token (Gemini 1.5) |

| Stärken | Langer Kontext, Nuancen, Sicherheit | Ökosystem, Plugins, Bekanntheit | Google-Integration, Bilder |

| Schwächen | Manchmal zu vorsichtig | Tendenz zu Ja-Sager-Antworten | Halluzinationen bei Fakten |

Stand: Mai 2026. Modelle entwickeln sich schnell — Vergleiche veralten rasch.

Claude verstehen

Constitutional AI — was das konkret bedeutet

Anthropic hat Claude nicht nur darauf trainiert, nützlich zu sein. Sondern auf eine spezifische Art nützlich zu sein.

Standard-RLHF (ChatGPT)

- Menschliche Rater bewerten Antworten

- Modell optimiert auf: „Was gefällt Menschen?"

- Risiko: Sycophancy — sagen, was Nutzer hören wollen

- Fakten können Bewertung schlechter machen als angenehme Lügen

Constitutional AI (Claude)

- Prinzipienliste als Trainingsgrundlage

- Modell bewertet sich selbst gegen diese Prinzipien

- Explizite Hierarchie: Sicherheit > Ethik > Prinzipien > Hilfe

- Ziel: Konsistenz, nicht nur Beliebtheit

Praktisch heißt das: Claude widerspricht öfter. Gibt Unsicherheit zu. Lehnt Anfragen ab — auch wenn das dem Nutzer nicht gefällt. Das ist ein Feature, kein Bug.

Schlüsselkonzept

Das Kontextfenster — Claudes Kurzzeitgedächtnis

Alles, was Claude in einem Gespräch „weiß", ist im Kontextfenster. Wenn das Gespräch endet — ist alles weg.

bei Claude 3.5 Sonnet

ca. 3 langen Romanen

Ende des Chats

Häufiger Fehler: Claude in einem neuen Chat fragen, was es in einem alten gesagt hat. Es hat keine Ahnung.

Kritisches Konzept

Halluzinationen — warum KI lügt, ohne zu lügen

KI-Modelle „lügen" nicht absichtlich. Sie tun etwas Seltsameres: Sie generieren plausiblen Text — auch wenn dieser falsch ist.

Wie es entsteht

Das Modell optimiert auf: „Was würde hier wahrscheinlich stehen?" — nicht auf: „Was ist wahr?" Wenn es keine sichere Antwort kennt, erfindet es eine plausible.

Besonders gefährlich: Zitate, DOIs, Gerichtsfälle, Zahlen — alles klingt richtig und ist manchmal komplett erfunden.

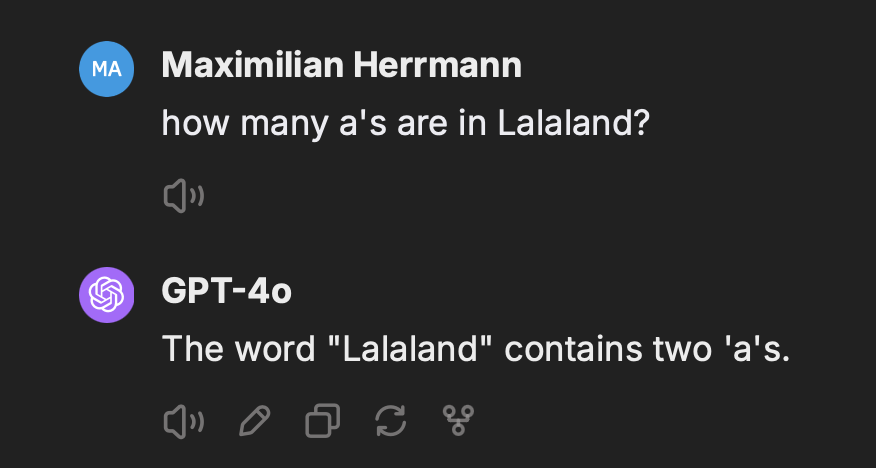

„Wie viele a's sind in Lalaland?"

→ GPT-4o: „Zwei"

Richtige Antwort: drei.

(La·la·land)

Teil 2

Prompt-Architektur

Wie man Anweisungen so schreibt, dass KI konsistent, vorhersagbar und nützlich antwortet — statt jedes Mal überrascht zu werden.

Grundlagen

Was ein Prompt wirklich ist

Ein Prompt ist nicht „eine Frage". Er ist die vollständige Konfiguration eines Gesprächs.

Rolle

Wer soll Claude sein? Was ist sein Auftrag? Sein Ton?

Kontext

Was muss Claude über dich, dein Ziel, deinen Hintergrund wissen?

Aufgabe

Was soll konkret geliefert werden? In welchem Format?

Schlechter Prompt

„Schreib mir eine E-Mail an meinen Chef."

Guter Prompt

„Du bist ein erfahrener Kommunikationsberater. Ich möchte meinem Chef erklären, dass das Projekt 2 Wochen später fertig wird als geplant. Ton: professionell, direkt, keine Ausflüchte. Max. 150 Wörter."

Prompt-Architektur

Die 5 Bausteine eines starken Prompts

- Rolle: „Du bist [X]" — gibt Claude einen Ausgangspunkt und einen Ton

- Kontext: Was Claude wissen muss, um gut zu helfen (Hintergrund, Zielgruppe, Situation)

- Aufgabe: Was konkret geliefert werden soll — so spezifisch wie möglich

- Format: Wie die Antwort aussehen soll (Stichpunkte, Fließtext, Tabelle, JSON, max. Länge)

- Einschränkungen: Was Claude nicht tun soll (keine Emojis, kein Fachjargon, keine Wiederholung der Frage)

Je mehr Claude weiß, desto besser die Antwort. Ein zu kurzer Prompt ist fast immer das Problem — nicht das Modell.

Praxisbeispiel

Einen starken Prompt bauen — live

Version 1 — naiv

Problem: Für wen? Wie tief? Welches Vorwissen?

Version 2 — mit Rolle + Zielgruppe

Besser. Aber: Wie lang? In welchem Format?

Version 3 — vollständig

Das liefert konsistent gute Ergebnisse — egal wie oft du es ausführst.

Fortgeschritten

System Prompts — Claudes Grundkonfiguration

Ein System Prompt ist eine Anweisung, die vor dem eigentlichen Gespräch gesetzt wird. Claude verhält sich danach in der gesamten Sitzung entsprechend.

Wo du sie einstellst

- In claude.ai: „Edit System Prompt" (Pro-Funktion)

- In Claude Projects: persistente Konfiguration für alle Chats im Projekt

- In der API: das

system-Feld

Beispiel System Prompt

Mit einem guten System Prompt musst du in jedem Chat deutlich weniger erklären — Claude kennt bereits deinen Kontext und Stil.

Fehler vermeiden

Die häufigsten Prompt-Fehler

| Fehler | Warum er passiert | Bessere Alternative |

|---|---|---|

| „Schreib etwas über X" | Keine Länge, kein Format, kein Ton | Format + Länge + Zielgruppe angeben |

| „Mach das besser" | Kein Kriterium für „besser" | „Kürzer, direkter, ohne Fachjargon" |

| Kein Feedback auf Antwort | Man gibt auf statt zu iterieren | „Das war zu lang. Probier es in 3 Sätzen." |

| Prompt in neuem Chat wiederholen | Kontext aus altem Chat angenommen | System Prompt oder Projektkontext nutzen |

| Alles in einen Prompt packen | Hofft auf magische Vollständigkeit | Aufgaben aufteilen, einzeln lösen |

Denkweise

Iteration ist kein Fehler — sie ist die Methode

Kein Prompt ist beim ersten Mal perfekt. Das ist kein Problem. KI-Nutzung ist ein Dialog, kein Befehl.

Wenn die Antwort zu ~70% stimmt — im Chat weiterarbeiten, nicht alles neu schreiben.

„Das ist gut, aber mach den zweiten Absatz konkreter."

Fortgeschrittene Technik

Chain of Thought — lass Claude laut denken

Bei komplexen Aufgaben hilft es, Claude explizit aufzufordern, Schritt für Schritt zu denken, bevor es eine Antwort gibt.

Ohne Chain of Thought

„Ist das ein gutes Argument?"

Claude gibt direkt eine Ja/Nein-Antwort. Oft oberflächlich.

Mit Chain of Thought

„Analysiere dieses Argument Schritt für Schritt: Welche Prämissen werden angenommen? Sind sie haltbar? Welche Gegenargumente gibt es? Dann gib ein Gesamturteil."

Studien zeigen: Modelle die Schritt für Schritt denken, machen deutlich weniger Fehler bei logischen Aufgaben. Das gilt auch für Claude.

Wei et al. (2022), „Chain-of-Thought Prompting Elicits Reasoning in Large Language Models"

Teil 3

Von Prompts zu Workflows

Der Unterschied zwischen jemand der KI gelegentlich nutzt — und jemand bei dem sie dauerhaft etwas verändert.

Konzept

Was ein KI-Workflow ist — und warum er besser ist

Einzelgespräch

- Jeden Tag neu erklären wer du bist

- Kontext jedes Mal von vorne aufbauen

- Ergebnisse variieren stark

- Kein Lerneffekt über Zeit

Persistenter Workflow

- System Prompt speichert deinen Kontext dauerhaft

- Aufgaben werden immer gleich formatiert

- Ergebnisse sind vorhersagbar

- Wiederholbare Qualität ohne Aufwand

Ein Workflow ist ein System, kein Gespräch. Es funktioniert auch dann noch gut, wenn du in 3 Monaten wieder zurückkommst.

Tool: Claude Projects

Claude Projects — persistente Kontexte

Claude Projects (verfügbar mit Claude Pro) erlauben es, einen dauerhaften Kontext für alle Chats in einem Projekt zu setzen.

Was du reinpacken kannst

- Deinen System Prompt (Rolle, Tonalität, Stil)

- Dokumente als Kontext (Lehrplan, Unterrichtsmaterialien, Texte)

- Explizite Arbeitsregeln

- Eigene Prompt-Templates als Referenz

Praxisbeispiel: Unterrichtsvorbereitung

Praxis

Eine persönliche Prompt-Bibliothek aufbauen

Gute Prompts sind wiederverwendbar. Wer sie nicht speichert, erfindet sie immer wieder neu.

Schreib-Prompts

- E-Mail kürzen

- Argument stärken

- Für Zielgruppe umschreiben

- Zusammenfassung erstellen

Analyse-Prompts

- Text auf Argumente prüfen

- Stärken/Schwächen auflisten

- Gegenargumente generieren

- Quellen-Bewertung

Unterrichts-Prompts

- Unterrichtsplan erstellen

- Differenzierung für 3 Niveaus

- Aufgaben für verschiedene Lerntypen

- Feedback auf Schülertext

Speichere Prompts in einer einfachen Textdatei, Notion, oder Obsidian. Wichtig: Notiere auch warum ein Prompt gut funktioniert hat.

Anwendung

5 Workflows mit dem größten Nutzen

- Entwurf schreiben: „Schreib einen ersten Entwurf. Ich werde ihn selbst überarbeiten." → Startet von einer 70%-Version statt von Null

- Dokument zusammenfassen: Langen Text einfügen, Claude gibt Kernpunkte + offene Fragen → Spart Lesezeit bei gleichem Verständnis

- Brainstorming-Partner: „Generiere 15 Ideen für X — auch ungewöhnliche" → Besser als allein denken, wenn man Denkblockaden hat

- Feedback einholen: „Hier ist mein Text. Wo ist das Argument schwach? Was fehlt?" → Unabhängige Perspektive ohne sozialen Druck

- Erklärung für Zielgruppe: „Erkläre das für jemanden ohne Vorkenntnisse" → Verständnischeck für eigene Texte

Ehrlichkeit

Was Workflows nicht lösen

Bleibt dein Problem

- Ob das Ziel das richtige ist

- Ob die Fakten stimmen

- Ob der Stil wirklich zu dir passt

- Ob die ethischen Implikationen bedacht sind

- Die finale Entscheidung

Was Workflows abnehmen

- Ersten Entwurf schreiben

- Struktur vorschlagen

- Alternativen generieren

- Formatierung übernehmen

- Wiederholende Aufgaben skalieren

KI ist ein Werkzeug das dir Zeit gibt, besser zu denken — nicht eines das das Denken übernimmt.

Teil 4

Qualität bewerten und iterieren

Wie du erkennst ob eine KI-Antwort wirklich gut ist — und was du tust wenn sie es nicht ist.

Qualitätskriterien

Wann ist eine KI-Antwort wirklich gut?

„Klingt gut" ist kein Qualitätskriterium. Hier sind echte Kriterien:

Faktisch richtig?

Überprüfbar. Keine erfundenen Zahlen oder Quellen. Bei Unsicherheit: gibt Claude das zu?

Aufgabe erfüllt?

Hat Claude wirklich das geliefert was gefragt war — oder etwas Ähnliches, das leichter zu generieren war?

Für Zielgruppe geeignet?

Passt Tonalität, Komplexität und Umfang zu dem Menschen der es lesen wird?

Größte Falle: Flüssiger Text klingt überzeugend — auch wenn er falsch ist. Lese KI-Antworten kritisch, nicht bewundernd.

Praxis

Wie man Claude im Chat korrigiert

Claude verbessert sich innerhalb eines Gesprächs durch konkretes Feedback.

Vages Feedback (hilft nicht)

- „Das war nicht gut"

- „Versuch es nochmal"

- „Besser bitte"

- „Ich mag das nicht"

Konkretes Feedback (hilft)

- „Zu lang — auf 100 Wörter kürzen"

- „Formulierung in Zeile 3 ist zu formell"

- „Du hast Punkt 2 vergessen"

- „Überschrift ist zu allgemein — mach sie spezifischer"

Stelle dir vor, du gibst einem menschlichen Mitarbeiter Feedback. Was würde helfen? Das gleiche gilt für Claude.

Umgang mit Grenzen

Wenn Claude eine Anfrage ablehnt

Claude lehnt manchmal Anfragen ab — auch solche, die harmlos sind. Das passiert aus drei Gründen:

Echter Verstoß

Die Anfrage verletzt echte Sicherheitsprinzipien. Nicht diskutieren — Anthropic hat das so entschieden.

Missverständnis

Claude hat den Kontext falsch interpretiert. Lösung: mehr Kontext geben, Absicht erklären.

Übervorsicht

Claude ist manchmal zu konservativ bei harmlosen Anfragen. Lösung: Zweck erläutern, Kontext klären.

Wenn Claude ablehnt: Erkläre wer du bist, was dein Ziel ist, und warum das legitim ist. Das löst die meisten Missverständnisse.

Kritische Grenze

Wann man KI nicht vertrauen sollte

Niemals ungeprüft übernehmen

- Medizinische oder rechtliche Aussagen

- Statistische Zahlen ohne Quellenangabe

- Aktuelle Ereignisse (Trainingsdaten veralten)

- Zitate von realen Personen

- Literaturangaben und DOIs

Hier ist KI verlässlicher

- Bekannte Konzepte erklären

- Argumentationsstruktur und Logik

- Textüberarbeitung und Stil

- Ideen generieren und variieren

Anwalt Steven Schwartz nutzte ChatGPT für einen Schriftsatz. Es zitierte 6 Gerichtsfälle als Belege.

Alle sechs waren erfunden.

Der Richter war not amused. Schwartz bekam eine Geldstrafe.

Teil 5

KI in konkreten Kontexten

Wie KI-Workflows in Schule, Studium und Beruf konkret aussehen — nicht theoretisch, sondern praxisnah.

Kontext: Schule

KI im Unterricht — für Lehrende

Zeitsparen in der Vorbereitung

- Ersten Entwurf einer Unterrichtseinheit generieren

- Differenzierungsmaterial für 3 Niveaus

- Quizfragen und Aufgaben zu einem Text erstellen

- Erklärungen für verschiedene Altersgruppen

Wichtige Einschränkungen

- KI kennt eure Schüler nicht — Kontext fehlt immer

- Keine personenbezogenen Schülerdaten eingeben

- Fachdidaktisches Urteil bleibt bei der Lehrkraft

- Fachinhalte immer prüfen — KI irrt

KI als Assistenz, nicht als Ersatz: Der pädagogische Kern — Beziehung, Beurteilung, Anpassung — bleibt menschlich.

Kontext: Schülerinnen & Schüler

KI als Lernpartner — die entscheidende Unterscheidung

KI sinnvoll nutzen

- „Erkläre mir X anders als im Buch"

- „Prüfe ob mein Argument logisch ist"

- „Gib mir Feedback auf meinen Text"

- „Welche Fragen sollte ich noch stellen?"

- „Zeig mir ein Beispiel für Konzept Y"

KI nutzen statt denken

- Aufsätze direkt abgeben lassen

- Hausaufgaben generieren statt lösen

- Antworten kopieren ohne Verständnis

- Sich auf Fakten verlassen ohne zu prüfen

- Den eigenen Denkprozess überspringen

„Die Schüler die KI als Sparringspartner nutzen — die werden besser. Die die es zum Abschreiben nutzen — bleiben stehen."

Kontext: Studium & Wissenschaft

KI im akademischen Kontext

Erlaubt und sinnvoll

- Literatur verstehen und zusammenfassen

- Eigene Argumente testen

- Schreibblockaden überwinden

- Code für Auswertungen schreiben

Je nach Kontext

- Formulierungshilfe (uni-spezifisch prüfen)

- Strukturvorschläge

- Thesengenerierung als Ausgangspunkt

Niemals

- Arbeiten als eigene ausgeben

- Quellen nicht prüfen

- KI-generierte Argumente als eigene Analyse

Prüfe immer die Regelung deiner Einrichtung. Viele Hochschulen aktualisieren ihre Richtlinien gerade.

Kontext: Beruf

KI im Berufsalltag — wo sie wirklich Zeit spart

Kommunikation

- E-Mails kürzen und schärfen

- Ton für verschiedene Empfänger anpassen

- Schwierige Gespräche vorbereiten

- Meeting-Protokolle strukturieren

Analyse

- Große Textmengen zusammenfassen

- Argumentationsstrukturen extrahieren

- Daten beschreiben und interpretieren

Datenschutz: Was niemals rein darf

Keine echten Namen, Kundendaten, Unternehmensgeheimnisse, Personalnummern, oder vertrauliche Vertragsdaten in öffentliche KI-Modelle eingeben.

Viele Unternehmen setzen eigene Claude-Instanzen auf (via API) mit eigenen Datenschutzvereinbarungen. Das ist der sichere Weg für sensible Daten.

Teil 6

KI in Gruppen und Teams einführen

Warum das größte Hindernis nicht Technologie ist — und wie man es trotzdem schafft.

Gruppenpsychologie

Warum KI-Einführungen in Gruppen scheitern

Das häufigste Muster: Ein Workshop, begeisterte Reaktion, dann: nichts ändert sich.

Warum das passiert

- Keine konkreten Aufgaben für die erste Woche

- Kein geteiltes Verständnis was „gut" aussieht

- Angst vor Blamage beim Ausprobieren

- Kein Team-Champion der nachhält

- Zu abstrakt — kein Bezug zur echten Arbeit

Was stattdessen funktioniert

- Konkrete Aufgabe sofort im Workshop ausprobieren

- Jeder bringt eine eigene Aufgabe mit

- Erste Woche: ein bestimmter Anwendungsfall

- Team-Champion bestimmen

- Erfahrungen teilen — auch Misserfolge

Struktur

Der Team-Champion — warum eine Person zählt

Gruppen brauchen eine Person, die nicht nur KI nutzt, sondern das Wissen weitergibt.

Was ein Team-Champion tut

- Neue Prompts und Workflows ausprobieren

- Andere auf dem Laufenden halten

- Wenn etwas nicht klappt: nachfragen und weitergeben

- Eigene Prompt-Bibliothek teilen

- Neue Tools einschätzen bevor das Team sie nutzt

Was einen guten Champion ausmacht

- Neugier und Bereitschaft zu experimentieren

- Geduld für Fragen der Kolleginnen

- Kein Perfektionismus — Ausprobieren ist das Ziel

- Kommunikationsstärke: Dinge einfach erklären

Das muss kein Technik-Experte sein. Oft sind die besten Champions Menschen mit pädagogischem Instinkt.

Team-Struktur

Gemeinsame Regeln für KI-Nutzung im Team

Ohne Regeln entstehen Inseln: Jeder macht es anders, niemand profitiert voneinander.

Drei sinnvolle Regeln

- Transparenz: Wenn KI genutzt wurde, ist das kein Geheimnis — sondern ein Ausgangspunkt für Gespräch

- Teilen: Prompts, die gut funktionieren, kommen in die geteilte Bibliothek

- Verantwortung: Was KI generiert, hat mein Name drunter — ich bin verantwortlich

Was Teams vereinbaren sollten

- Welche Modelle werden genutzt (und warum)?

- Was darf nicht in externe KI-Modelle?

- Wie kennzeichnen wir KI-gestützte Texte intern?

- Wer hält die Prompt-Bibliothek aktuell?

Zusammenfassung

Das Kernprinzip — in einem Satz

KI macht dich nicht besser, indem sie für dich denkt. Sie macht dich besser, indem sie dir Zeit gibt, tiefer zu denken.

Verstehen

Was Modelle tun — und was sie nicht tun

Gestalten

Prompts und Workflows, die wirklich funktionieren

Urteilen

KI-Outputs kritisch bewerten, nicht unkritisch übernehmen

Modul 3 abgeschlossen

Du hast jetzt das Werkzeug.

Der Rest ist Praxis.

Prompts ausprobieren. Workflows bauen. Resultate kritisch lesen. Wiederholen.